近日,中国科学院合肥物质院智能所谢成军研究员与张洁副研究员团队的三项科研成果被计算机视觉领域顶级会议CVPR 2026接收。其中,面向高分辨率视觉语言理解的研究成果被主会接收并被推荐为Highlights论文,面向遥感全色锐化的研究成果被主会接收,面向农业害虫细粒度识别的多模态研究成果被CVPR 2026 Findings接收。第一作者分别为硕士研究生胡涛、曹可、李薛恒。

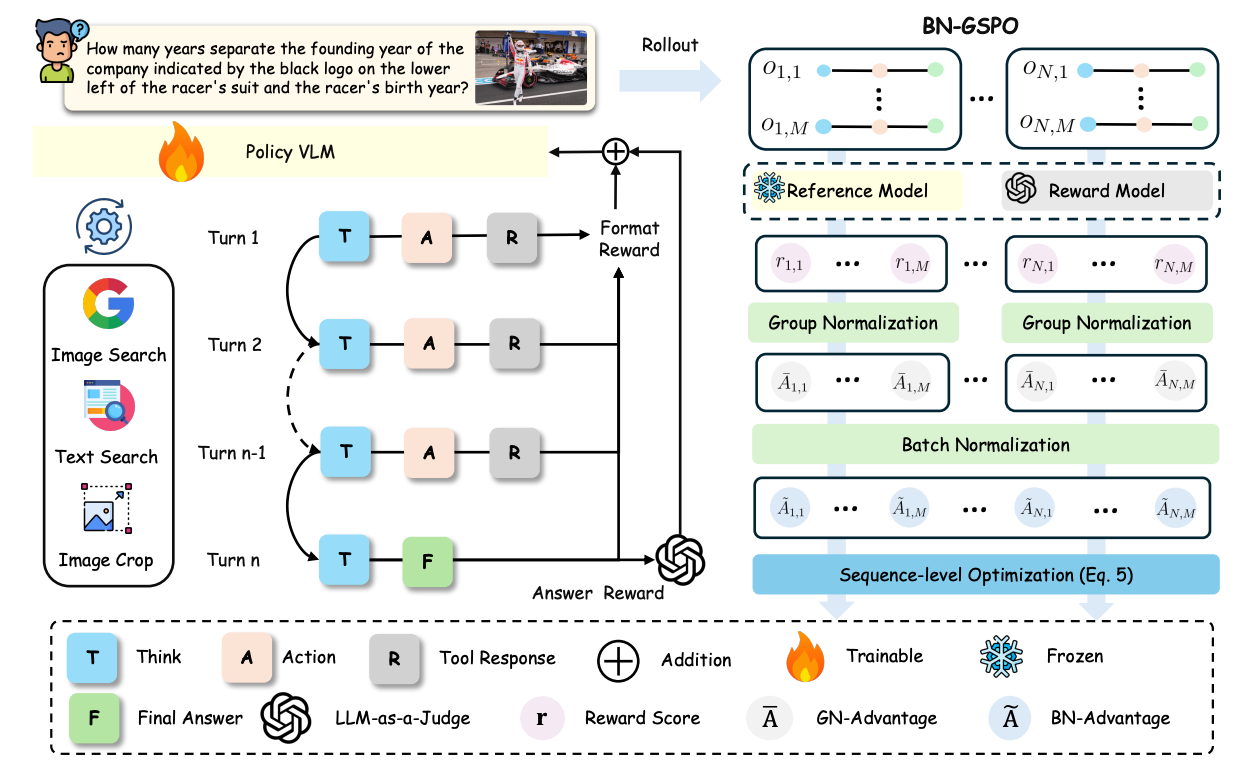

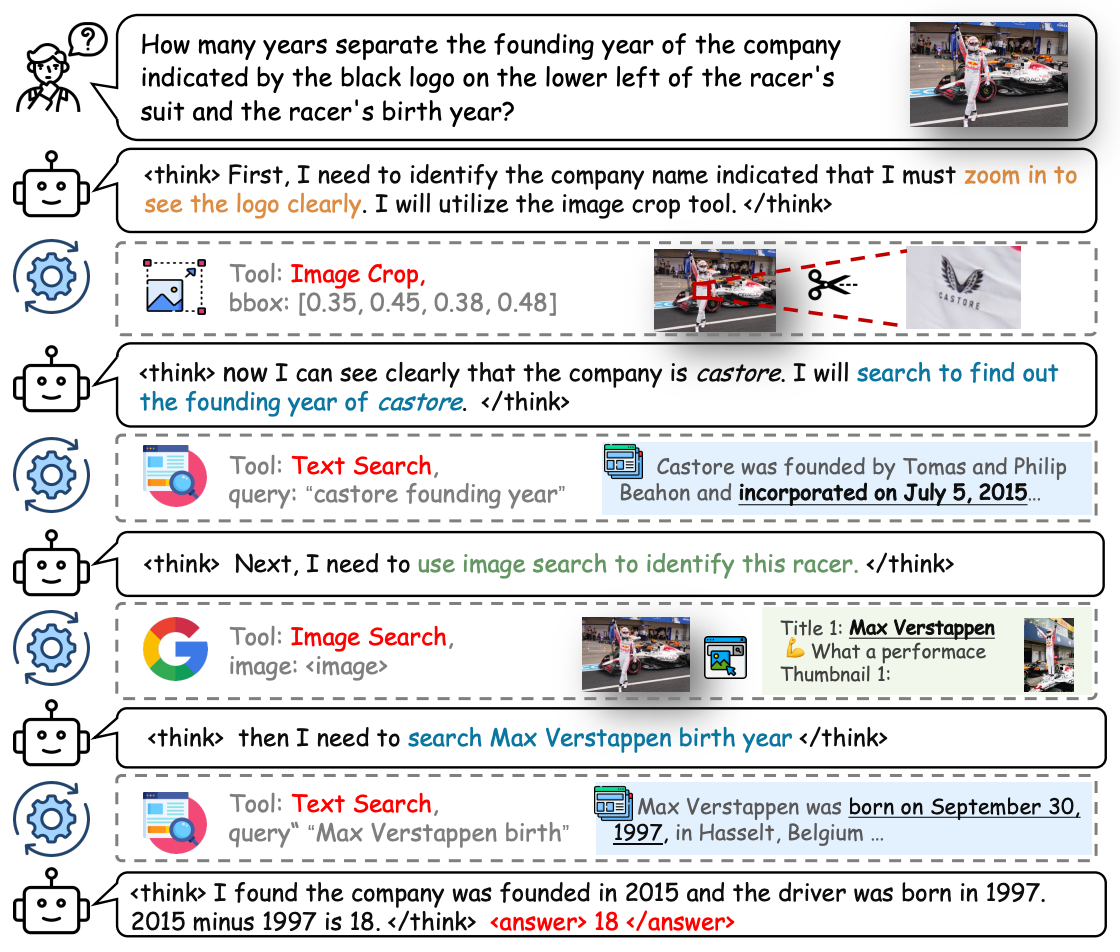

在高分辨率视觉语言理解的研究成果方面,研究团队提出了一种创新的高分辨率Agentic搜索推理框架SenseSearch。该方法在推理过程中统一集成了文本搜索、图像搜索与图像裁剪三类工具,使模型能够围绕问题进行多轮规划、主动检索外部知识,并聚焦图像中的关键局部区域,从而提升对复杂视觉场景的理解能力。与此同时,进一步提出了BN-GSPO强化学习算法,以增强多工具调用过程中的训练稳定性与推理鲁棒性;并构建了首个面向高分辨率、知识密集型、搜索驱动任务的基准 HR-MMSearch,用于系统评估模型的搜索推理与细粒度视觉分析能力。实验结果表明,SenseSearch在多项开放式搜索与高分辨率视觉理解基准上取得了领先性能:在HR-MMSearch上相较基线提升19.18%,为构建更强的Agentic视觉语言模型提供了一条有效路径。

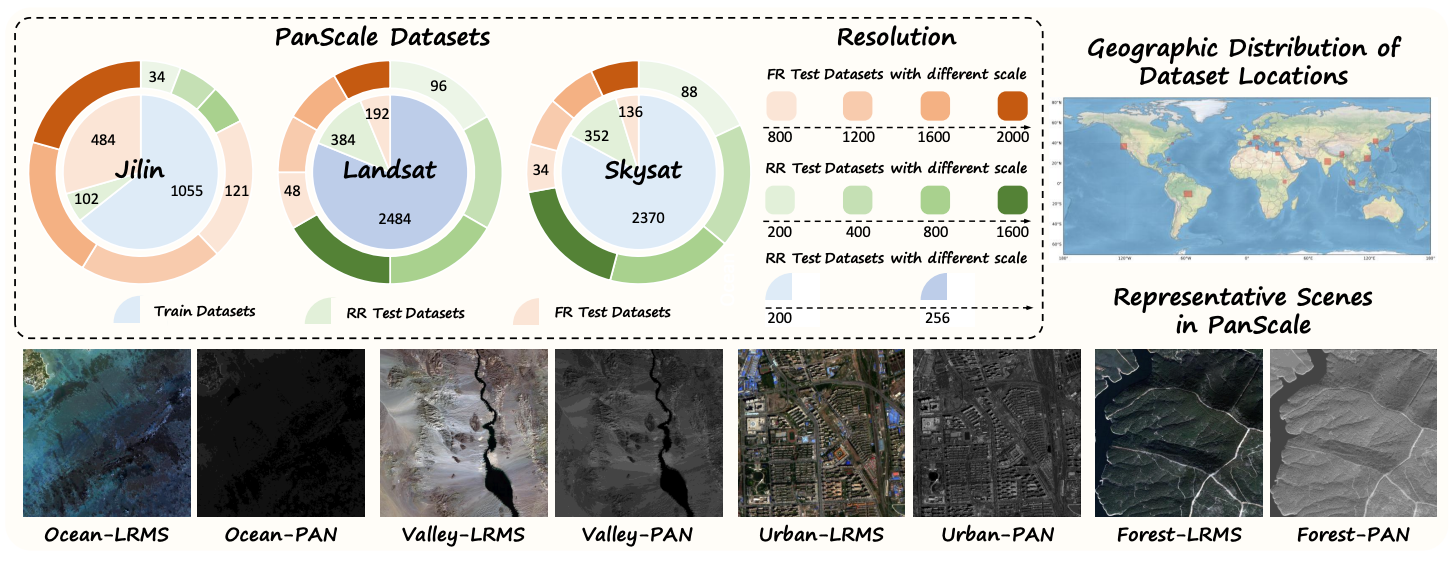

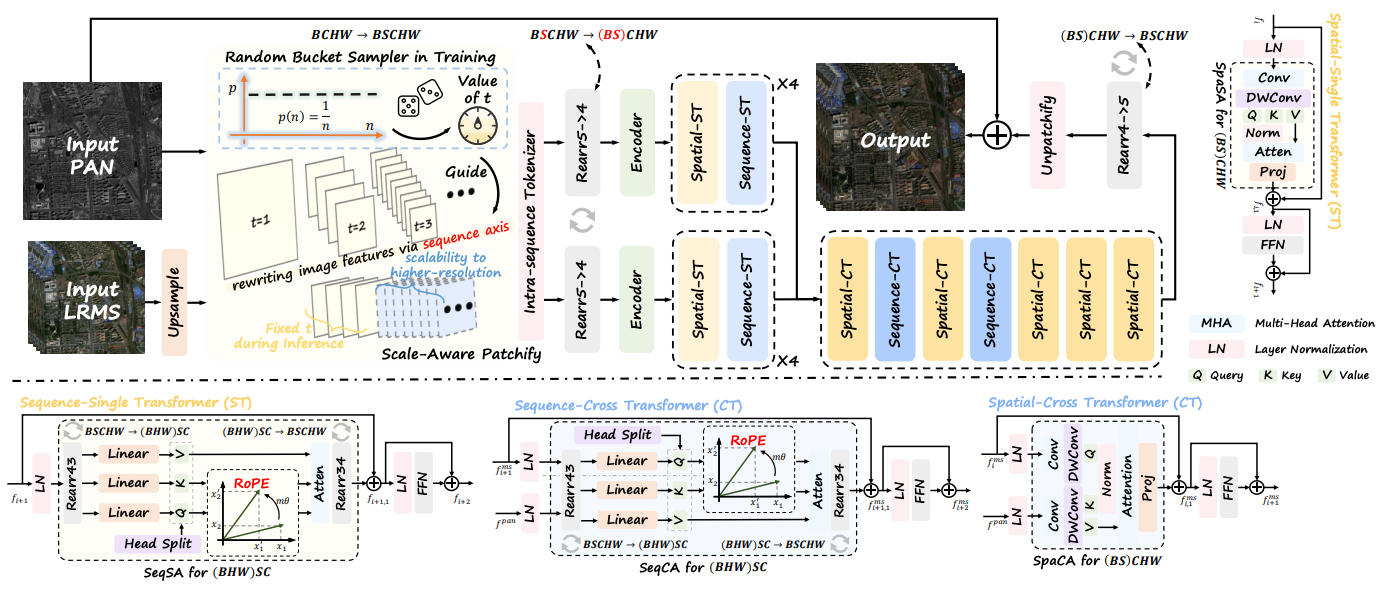

在面向遥感全色锐化方面,研究团队提出了一种跨尺度全色锐化框架ScaleFormer,并构建了首个面向跨尺度全色锐化任务的大规模数据集PanScale及评测基准PanScale-Bench。该方法将跨分辨率泛化问题重新建模为跨序列长度泛化,通过尺度感知分块和空间-序列解耦建模等关键设计,使模型能够在不同尺度输入下更稳定地完成空间细节注入与光谱信息保持。同时,相较于现有方法,该框架在处理大尺度图像时还具备更好的计算效率,能够有效缓解高分辨率推理中的计算与存储压力。实验结果表明,ScaleFormer在多个跨尺度遥感图像数据集上均取得了优于现有主流方法的性能表现,为遥感图像融合从固定分辨率训练走向面向真实场景的跨尺度泛化提供了新的研究思路。

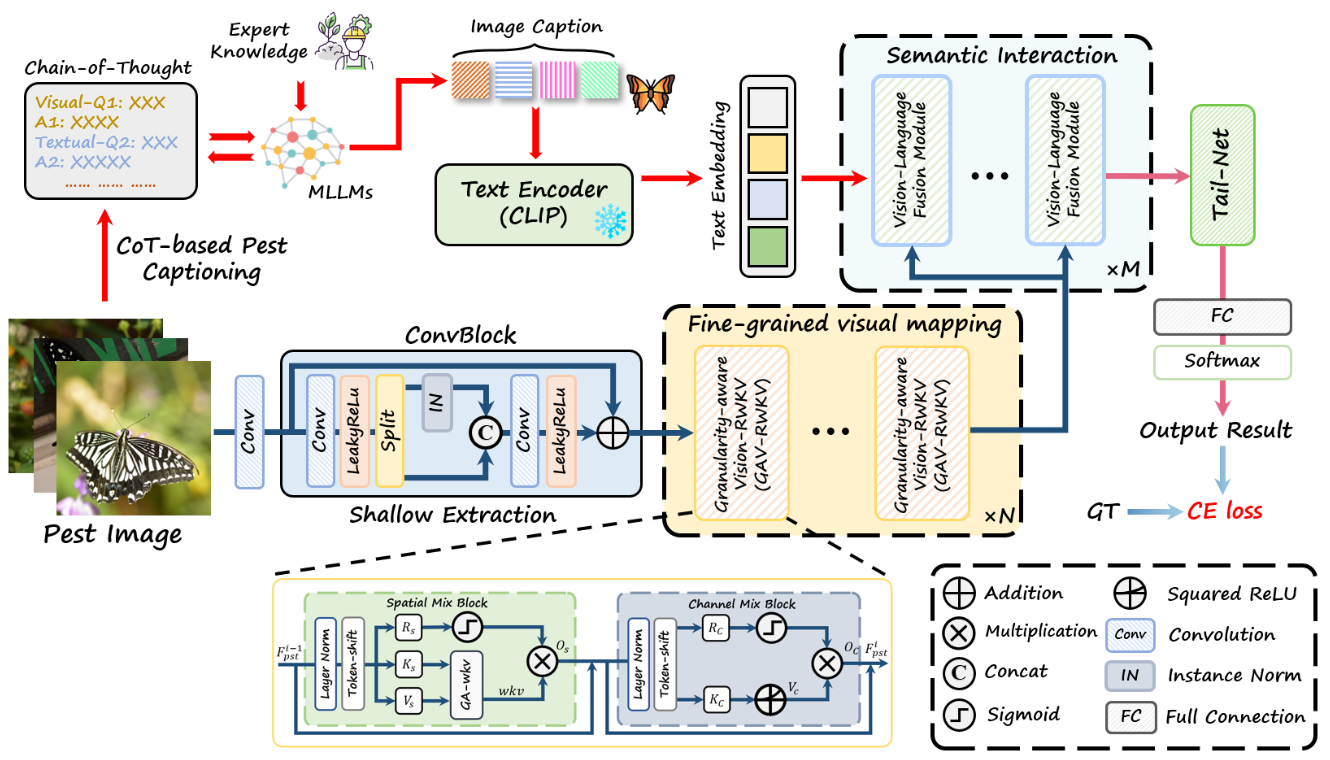

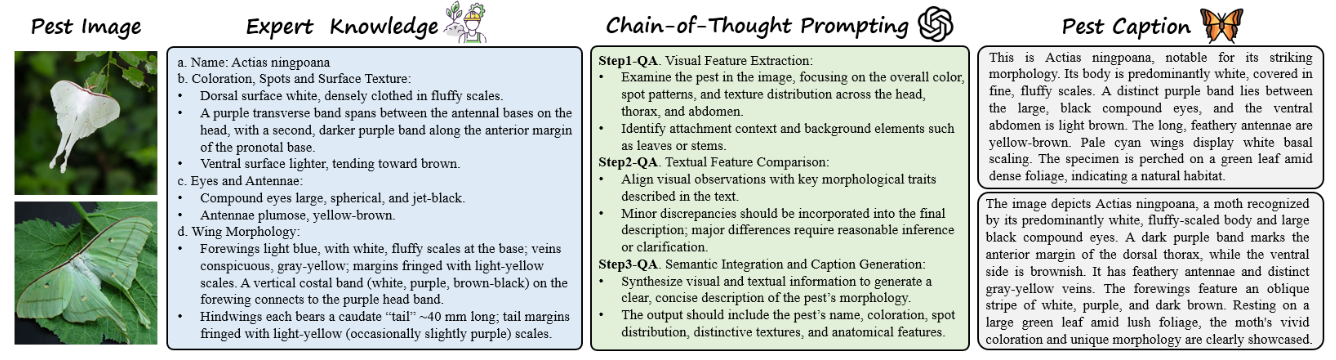

在农业害虫细粒度识别方面,研究团队提出了一种创新的多模态害虫学习框架PestVL-Net。该框架在视觉端引入RWKV架构与显著性引导的自适应窗口划分机制,以精准捕捉害虫的细粒度外观特征;在语言端则结合农业专家知识与多模态思维链(CoT)推理,引导大语言模型(MLLM)生成准确的文本语义描述。通过视觉与文本表征的深度融合,PestVL-Net有效克服了复杂害虫特征的识别难题。在Li dataset及两个全新构建的多物种数据集(QianFSD和AgriInsect)上,该模型分别取得了88.49%、86.72%和90.15%的最佳准确率,显著超越现有基线模型,为现实农业中的精准害虫管理提供了可靠的新方案。

上述研究工作得到了国家自然科金、安徽省自然科学基金、中央引导地方科技发展基金的支持。

据悉,CVPR 由IEEE(电气电子工程师学会)和CVF(计算机视觉基金会)共同主办,是中国计算机学会(CCF)推荐的A类国际学术会议。本届CVPR 共收到投稿16092篇,经过全面严格的审查程序,最终录用4090篇,录取率约为25.42%。

论文链接:https://arxiv.org/abs/2512.24330

论文链接:https://arxiv.org/abs/2603.0054

论文链接:https://arxiv.org/abs/2604.17278

图1 SenseSearch训练框架

图2 SenseSearch智能体推理轨迹

图3 PanScale数据集

图4 ScaleFormer网络架构

图5 PestVL-Net网络架构

图6 PestVL-Net害虫语义生成